跟 AI 講話最重要的,從來不是那些「萬能 prompt 公式」。是兩件事:你會不會追問,跟你知不知道 AI 給你的答案其實每次都不太一樣。

我滿常被問怎麼跟 AI 講話才會問到好答案。網路上 prompt 教學一抓一大把,什麼 CRISPR、RTF、CO-STAR 框架,看起來都很厲害。

但我自己用 AI 兩年多,回頭看,真正讓我用 AI 比別人有效率的不是這些縮寫。是兩個觀念。一個是會追問,一個是知道 AI 給的東西本來就會浮動。可惜這兩個觀念很多人根本沒聽過,或者聽過但沒當一回事。

觀念一:第一次答案永遠不是最終版

我自己工作上常用的場景已經做成 skill 跟模板了,所以日常其實很少在「設計 prompt」。但我發現一個事:那些用 AI 用得不順的人,幾乎都是問一次就走了。

問一次,看到答案,覺得「嗯,差不多」,貼上去用,然後就出事。

這個習慣超普遍。可能是平常用 Google 搜習慣了——關鍵字打進去,第一頁掃一掃就找到答案。但 AI 不是這樣運作的。AI 給你的第一個回答幾乎永遠是「最安全、最通用、最不會錯」的版本,但通用就代表它沒真的針對你的情況。

舉個我自己的例子。前陣子我在寫一篇軟體架構的文章(主題叫「微服務拆分」,你不懂細節沒關係),我問 AI「幫我列出微服務拆分常見的錯誤」。它給我一個五點清單,全是教科書答案——拆太細、共用資料庫、沒做版本管理那些。沒錯,但網路上隨便搜都有,講出來沒意思。

我接著追問「這五點裡面哪一點是新手最容易踩、但自己不會發現的?」。答案就開始有畫面了。再追「能舉一個讓人 facepalm 的真實 case 嗎?」,案例就出來了。再追「如果是用 NestJS 寫的小團隊,第一個會踩到的是哪個?」,那個答案我才真的拿來改一改用上去。

從第一個答案到能用的答案,中間隔了三輪追問。如果我問一次就停,文章就會變成另一篇大家都看過的爛文章。

追問不需要技巧,幾個方向就夠用:

- 「這裡面哪個最重要?為什麼?」

- 「能舉一個具體的例子嗎?」

- 「如果是 [我的具體情況] 呢?」

- 「你剛剛說的 X,跟 Y 有什麼差別?」

- 「你覺得這個建議在什麼情況下會反而害人?」

最後一個我用得最多。因為 AI 預設超愛給「正向、平衡、各方都有道理」的答案,逼它講反面才會看到真的有用的東西。

觀念二:你問的問題答兩次,答案會不一樣

這個更妙。

很多人不知道,同樣一個 prompt 你今天問跟明天問,甚至連續問兩次,AI 給的答案都會不一樣。有時候差一點點,有時候結構整個跑掉。

這個跟一個叫 temperature 的東西有關(就是模型內部控制「隨機性」的參數,數字越高答案越發散,越低越死板)。聊天介面這種預設 temperature 不是零,所以本質上就是「每次都重新骰一次」。

那這件事為什麼重要?

因為很多人以為 AI 是一台「正確答案輸出機」。問什麼出來什麼,拿來就能用。如果你也這樣以為,你就會:

第一,遇到一個爛答案以為這就是 AI 的極限——其實再問一次可能就好了。

第二,遇到一個好答案以為這就是「正確答案」,貼上去用——其實這只是這次運氣好,下一次可能就翻車。

我看過最荒謬的是有人用 AI 算數字,算出來覺得很合理就直接放進報告。隔週重新問同一題驗證,數字不一樣。然後他第一個反應是「AI 壞掉了」。沒有,AI 沒壞,是他不知道 AI 本來就會這樣。

所以正確的用法是反過來的:

重要的事,問三次,看哪個版本品質最好。或者問同一件事用不同方式講三次,看 AI 給的答案核心邏輯有沒有變。如果三次答案的「結論」都一樣,這個結論你比較可以信。如果三次差很多,代表這題 AI 自己也沒把握,你就要去找別的來源驗證。

這個習慣養成之後,你會自動避開很多坑。

Prompt 技巧本身倒是很簡單

把上面兩個觀念講完,剩下的 prompt 技巧反而不重要了。但既然講到了還是順手帶一下。

最有用的三個,依序:

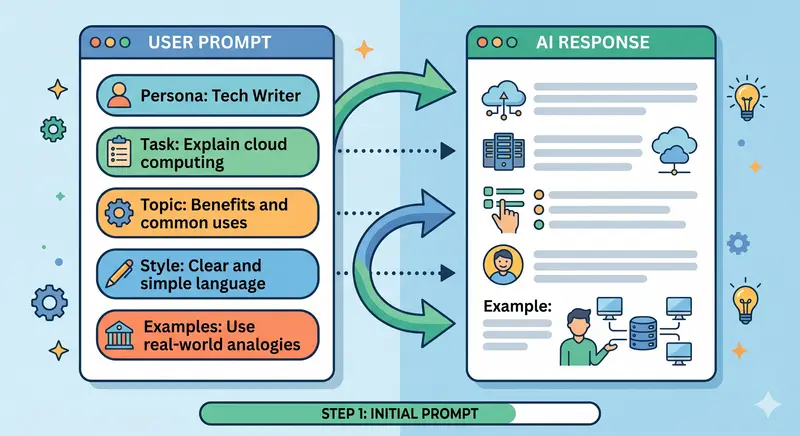

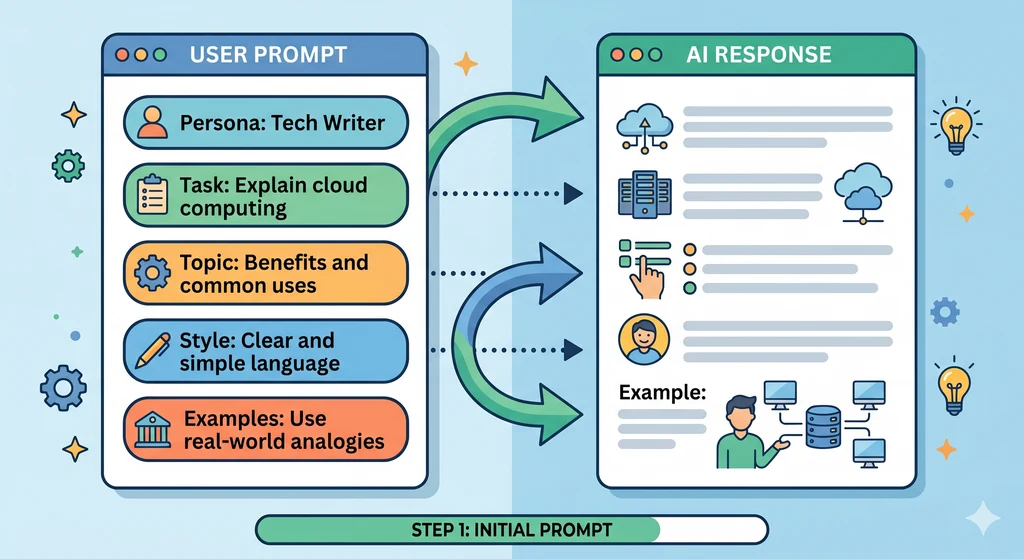

給角色。「你是一位有十年經驗的小學自然老師,幫我把這段話改寫成國小五年級看得懂的版本」這種。它幫你框定回答的口吻跟深度。但別玩太花,「你是宇宙最強的全能大師」這種反而沒用,因為角色越虛幻,AI 越不知道要怎麼演。

給範例。如果你要 AI 模仿某種風格,丟一兩段你喜歡的範例給它,比形容半天「我要那種輕鬆又專業的口氣」有效十倍。

指定格式。「用三段話回答,每段不超過五十字」「給我一個表格,欄位是 A、B、C」這種。AI 自由發揮的時候常常給你寫太長,明確規定格式可以省很多刪減的時間。

其他什麼 CO-STAR、CRISPR、各種神奇縮寫框架,我自己沒在用。我用了兩年下來覺得,把上面三個技巧加上「會追問、知道答案會變」的觀念,已經比 95% 的 AI 使用者好用了。

結尾

所以再講一次,因為很多人讀了還是不會做:

不會追問,AI 給你的就是「教科書版本」,網路搜尋還比較快。

不知道 AI 答案會浮動,你就會被自己騙——以為 AI 給你的是真理,其實是這次的隨機骰子剛好骰得不錯。

prompt 公式記再多,這兩件事不做就是白搭。